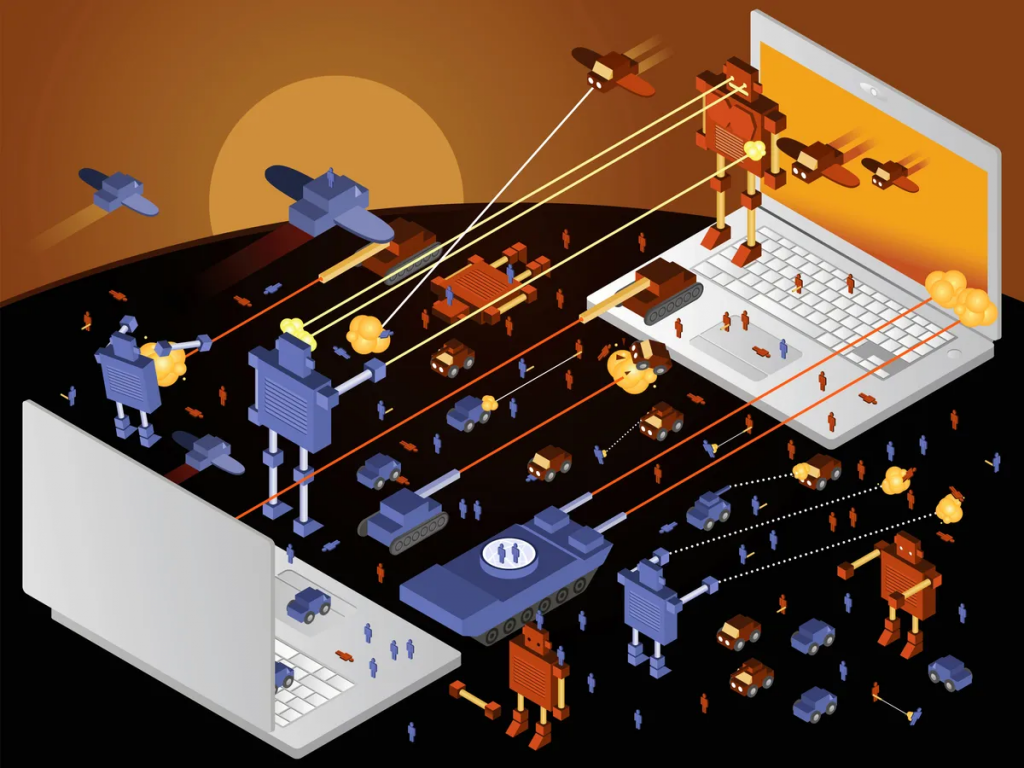

인공지능의 발전이 빨라지면서 더 많은 일을 해내고 있습니다. 이에 따라 기술의 오용 및 남용에 대해서도 논의가 빨라지고 있는데, 그 중에서도 가장 무거운 주제는 군사용으로의 사용일 것 입니다. 이번 포스팅에서는 페이스북으로 유명한 메타 플렛폼에서 미군에 인공지능 모델을 제공하는 내용을 소개하는 IEEE Spectrum 글을 통해 관련 내용을 소개 드립니다.

개요

Meta의 오픈형 대규모 언어 모델 가족인 Llama는 전통적인 의미의 “오픈소스”는 아니지만, 다운로드 및 활용이 자유롭게 가능하며, 국방 기관을 포함한 다양한 조직에서 이를 사용하고 있습니다.

최근 로이터의 보도에 따르면, 중국 연구자들이 Llama 모델을 군사 기록에 맞게 조정하여 군사 정보 분석 도구를 개발한 사례가 확인되었습니다. 이에 대해 Meta의 공공정책 이사는 이를 “무단 사용”으로 규정했습니다. 하지만 3일 후, Meta의 대외 정책 사장인 닉 클레그는 Meta가 미국 국가 안보를 위해 Llama의 사용을 허용할 것이라고 발표했습니다.

하버드 버크만 클라인 인터넷 & 사회 센터의 연구원 벤 브룩스는 이에 대해 “이러한 모델에 적용된 많은 가드레일(안전 장치)들이 유동적이라는 점을 보여준다”고 평가했습니다.

Meta의 미국 국방 지원 움직임

로이터의 조사에 따르면, 중국 군사과학원 연구자들이 Meta의 Llama 대규모 언어 모델 중 130억 파라미터 버전을 사용하여 ChatBIT라는 AI 도구를 개발했습니다. 이는 군사 정보 분석 및 의사결정에 사용되었으며, 중국 인민해방군이 오픈소스 AI 모델을 국방 목적으로 적응시킨 첫 번째 명확한 사례로 평가됩니다.

Meta는 로이터에 ChatBIT가 자사의 허용 사용 정책을 위반했다고 밝혔습니다. 해당 정책은 Llama의 군사, 전쟁, 첩보, 핵산업 및 관련 응용 프로그램에서의 사용을 금지하고 있습니다. 하지만 3일 후, 클레그는 Meta가 미국 국방 산업을 지원한다고 공식적으로 발표했습니다.

이는 이례적인 전개로 보였는데, Llama의 군사적 사용은 Meta의 허용 사용 정책에 위배되기 때문입니다. Meta는 사용 승인을 요구하지 않기 때문에 정책을 강제할 방법은 없었지만, 그간 회사는 군사적 사용에 반대 입장을 유지해왔습니다.

이 입장은 여전히 유효하지만, 이제 미국 외의 군사에만 적용됩니다. Meta 대변인은 IEEE Spectrum에 Llama의 조건이 변경된 것은 아니며, 대신 미국 정부 및 이를 지원하는 기업들에게만 군사적 사용 정책을 “면제”했다고 밝혔습니다.

Meta만이 미국 국방을 지원하는 데 몰두하는 것은 아닙니다. Anthropic의 Claude 3 및 Claude 3.5 모델은 방위 계약업체 Palantir에 의해 비밀 정부 데이터를 분석하는 데 사용될 예정입니다. OpenAI는 최근 Palantir 전 CISO였던 데인 스터키를 고용하고, 미 육군 퇴역 장군 폴 M. 나카소네를 이사회에 임명했습니다.

브룩스는 이에 대해 “모든 주요 AI 회사들이 미국 국가 안보에 대한 헌신을 열렬히 보여주고 있기 때문에 Meta의 반응은 놀랍지 않습니다. 오히려 오픈 AI 모델이 잠재적 적국에게는 접근 가능하면서 국내적으로는 엄격한 국가 안보 또는 국방 제한을 적용하는 것은 이상한 결과였을 것”이라고 말했습니다.

AI, 국방, 규제의 향후 방향

Meta의 결정으로 인해 Llama가 미국 정부와 승인된 군사 계약업체들에 의해 채택될 가능성이 열렸지만, 이는 오픈 AI 모델의 확산을 되돌리지는 못합니다. 로이터의 보도가 보여주듯이, Llama 모델은 이미 군사적 용도로 활용되고 있으며, 그 허가 여부는 상관이 없습니다. 이제 규제 당국이 이에 대해 어떤 조치를 취할지의 문제가 제기됩니다.

캘리포니아 기술과 민주주의 이니셔티브의 선임 정책 고문인 데이비드 에반 해리스는 오픈 모델에 대한 더 강력한 규제를 촉구했습니다. 그는 2023년 IEEE Spectrum에 AI 오픈 모델의 위험에 대한 기고문을 발표한 바 있습니다.

해리스는 “Meta가 첨단 기술을 보호하지 않기로 선택하면서, 글로벌 AI 군비 경쟁을 단독으로 촉진하고 있습니다. Meta가 제공하는 상위 3개의 모델은 모두 무방비 상태입니다”라며, Meta의 결정은 록히드 마틴이 정교한 군사 기술을 미국 적국에게 제공하는 것과 비슷하다고 비판했습니다.

반면 브룩스는 오픈 모델이 더 투명하며, 기회나 취약성을 평가하기 더 쉽다고 주장했습니다. 그는 Llama를 Linux 같은 인기 있는 오픈소스 소프트웨어에 비유하며, 많은 기업과 정부 기관이 이를 기반으로 맞춤형 응용 프로그램을 개발한다고 말했습니다. 브룩스는 “오픈소스 커뮤니티는 민감하고 규제된 AI 응용 프로그램에서 오픈 방식이 앞으로 나아갈 길이라고 보고 있습니다”라고 덧붙였습니다.

일론 머스크의 등장

해리스와 브룩스는 오픈 AI 규제에 대해 상반된 입장을 가지고 있지만, 한 가지에서는 의견이 일치했습니다. 바로 트럼프 대통령 당선이 변수로 작용할 가능성입니다.

트럼프 당선인의 AI에 대한 입장은 아직 명확하지 않지만, 그의 대선 캠페인 중 여러 차례 무대에 함께 올랐고 트럼프와의 긴밀한 관계를 유지하고 있는 것으로 알려진 일론 머스크는 차기 행정부의 AI 정책이 불확실하다는 점을 상징적으로 보여줍니다.

머스크는 AI 회사인 Grok의 소유주로, 10년 안에 AI가 인간보다 더 똑똑해질 것이라고 믿고 있습니다. 하지만 캘리포니아의 ‘첨단 AI 모델을 위한 안전하고 보안된 혁신법(Safe and Secure Innovation for Frontier Artificial Models Act)’을 지지하며, AI 연구에 대한 광범위한 제한을 요구한 바 있습니다(이 법안은 결국 주지사 개빈 뉴섬에 의해 거부되었습니다). 더 혼란스러운 점은, 머스크가 AI 규제를 지지하면서도 오픈 AI 모델을 선호하며, OpenAI가 자사의 모델 접근을 제한한 결정 등을 이유로 소송을 제기한 상태라는 점입니다.

브룩스는 이에 대해 “이번 선거 결과는 논의를 예상치 못한 방향으로 재편할 수 있습니다. 이 행정부에서는 ‘효과적 가속주의’ 문화와 ‘AI 중단’ 문화가 충돌할 가능성이 높아, 이를 지켜보는 것은 매우 흥미로울 것입니다”라고 말했습니다.

마무리

이번 포스팅에서는 트럼프 당선과 차기 행정부의 AI 정책에 대한 불확실성, 일론 머스크의 독특한 입장, 그리고 AI 규제에 대한 상반된 의견들을 다루어 보았습니다. AI 기술이 빠르게 발전함에 따라, 이를 어떻게 규제하고 활용할지에 대한 논의는 앞으로도 뜨거운 이슈로 남을 것입니다. 기술 혁신과 안전 사이에서 균형을 찾는 것이 무엇보다 중요하며, 각국 정부와 기업들이 어떤 방향으로 나아갈지 계속 주목해야 할 시점입니다.